LLMs与多模态AI:从理解到感知的跨越

2026年标志着多模态AI走向实用化的关键节点。生成式模型需要多感官化,才能像人类一样感知世界。这些模型将能够感知和行动于一个更像人类的世界,能够桥接语言、视觉和行动。IBM的研究人员指出,在不远的将来,我们将开始看到这些多模态数字工作者,能够自主完成不同的任务来解释事物,甚至可能像处理复杂医疗案例那样。

引言:AI的感知革命

大语言模型(LLM)的出现标志着人工智能在语言理解和生成方面取得了突破性进展。然而,真正的人工智能不仅需要理解语言,还需要像人类一样感知和作用于物理世界。

多模态AI(Multimodal AI)是指能够处理和融合多种模态(如文本、图像、音频、视频、传感器数据等)的AI系统。2026年,多模态AI正从实验室走向实用化应用,成为AI发展的重要方向。

一、大语言模型的演进

1.1 LLM的技术发展历程

大语言模型的发展经历了几个重要阶段:

预训练阶段:以BERT、GPT为代表的早期大语言模型,通过在海量文本上进行预训练,获得了强大的语言理解能力。这一阶段的主要特点是单向或双向的注意力机制,以及大规模的参数规模。

指令微调阶段:以InstructGPT为代表,通过对模型进行指令微调,使模型能够更好地理解和执行人类的指令。这一阶段引入了人类反馈强化学习(RLHF),显著提高了模型的指令遵循能力。

多模态融合阶段:以GPT-4V、Claude 3等为代表,模型开始具备多模态理解能力,能够同时处理文本、图像等多种模态的信息。

代理化阶段:以Claude的编码代理、AutoGPT等为代表,模型开始具备代理能力,能够调用工具、执行复杂任务。

推理能力阶段:以DeepSeek-R1、o1为代表,模型开始具备强大的推理能力,能够进行复杂的逻辑推理和问题求解。

1.2 LLM的核心能力

现代大语言模型具备以下核心能力:

语言理解:能够理解自然语言的语义、语境和意图,包括复杂的长文本理解。

语言生成:能够生成流畅、连贯、符合语法和语义的自然语言。

知识推理:能够利用预训练获得的知识进行推理和问题求解。

指令遵循:能够理解和执行人类的指令,完成指定的任务。

代码生成:能够理解编程语言的语法和语义,生成高质量的代码。

多语言支持:支持多种语言的处理和生成,实现跨语言的交流。

1.3 2026年LLM的重要进展

2026年,大语言模型取得了多项重要进展:

推理能力突破:中国实验室发布的推理模型(如DeepSeek-R1)展现了强大的推理能力,能够解决复杂的数学问题和逻辑推理问题。

开源生态繁荣:开源大语言模型(如Llama、DeepSeek、Granite等)的性能不断提升,接近或达到闭源模型的水平。

上下文窗口扩展:模型的上下文窗口不断扩大,能够处理更长的上下文,支持更复杂的任务。

记忆能力增强:模型开始具备长期记忆能力,能够在对话中记住之前的信息。

多模态融合深入:多模态能力不断增强,能够更准确地理解和生成跨模态的内容。

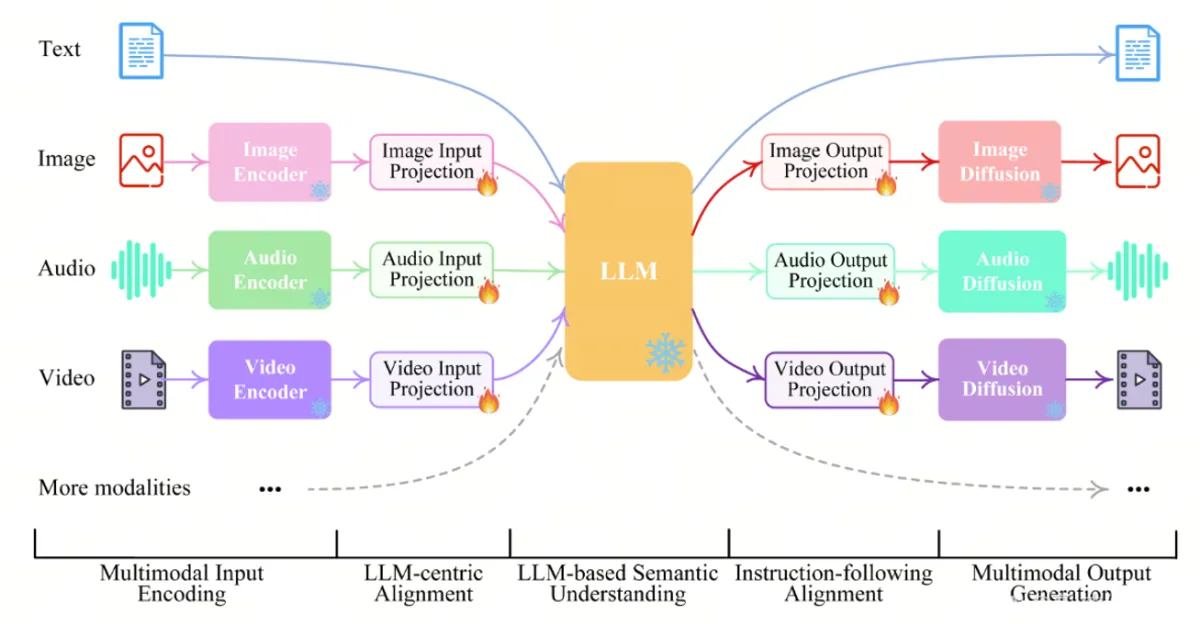

二、多模态AI的技术架构

2.1 多模态融合的方法

多模态AI的核心在于如何有效地融合不同模态的信息:

早期融合:在特征提取阶段就将不同模态的特征进行融合,然后输入到统一的模型中处理。早期融合的优点是信息损失少,但需要不同模态的特征空间对齐。

晚期融合:分别对不同模态进行处理,然后在决策阶段进行融合。晚期融合的优点是灵活性强,可以采用不同模态的专用模型,但可能丢失模态间的早期关联信息。

混合融合:结合早期融合和晚期融合的优点,在多个层级进行信息融合。

跨模态注意力:使用注意力机制实现跨模态的信息交互,使模型能够动态关注不同模态的相关部分。

2.2 多模态AI的技术挑战

多模态AI面临着以下技术挑战:

模态对齐:不同模态的信息如何对齐是一个核心问题。需要建立文本、图像、音频等模态之间的语义对应关系。

数据稀缺:高质量的跨模态标注数据稀缺,需要开发有效的数据收集和标注方法。

计算资源:多模态模型通常需要更多的计算资源,需要优化模型架构和训练算法。

评估标准:多模态AI的评估标准尚不完善,需要建立统一的评估框架。

可解释性:多模态模型的决策过程更加复杂,可解释性要求更高。

2.3 多模态AI的应用架构

多模态AI的应用架构通常包括以下几个层次:

感知层:负责采集和预处理不同模态的原始数据,包括图像采集、语音采集、文本输入等。

特征提取层:从原始数据中提取特征,包括图像特征、语音特征、文本特征等。

融合层:将不同模态的特征进行融合,形成统一的表征。

推理层:基于融合后的表征进行推理和决策。

输出层:生成多模态的输出,包括文本生成、图像生成、语音合成等。

三、多模态AI的应用

3.1 医疗健康

多模态AI在医疗健康领域具有重要的应用价值:

医学影像诊断:结合医学影像(CT、MRI、X光等)和临床文本(病历、报告等),提高诊断准确性。微软AI的诊断编排器(MAI-DxO)在2025年演示了解决复杂医学案例的能力,准确率达到85.5%,远高于经验医师20%的平均水平。

症状分诊:结合患者的症状描述和医学知识,进行症状分析和分诊建议。AI正在从诊断专长扩展到症状分诊和治疗规划等领域。

治疗规划:结合患者的多模态信息,制定个性化的治疗方案。

健康监测:结合可穿戴设备的传感器数据和患者的自我报告,实现持续的健康监测和预警。

世界卫生组织预测,到2030年将短缺1100万卫生工作者,导致45亿人缺乏基本的卫生服务。AI在医疗健康领域的应用有望缓解这一危机。

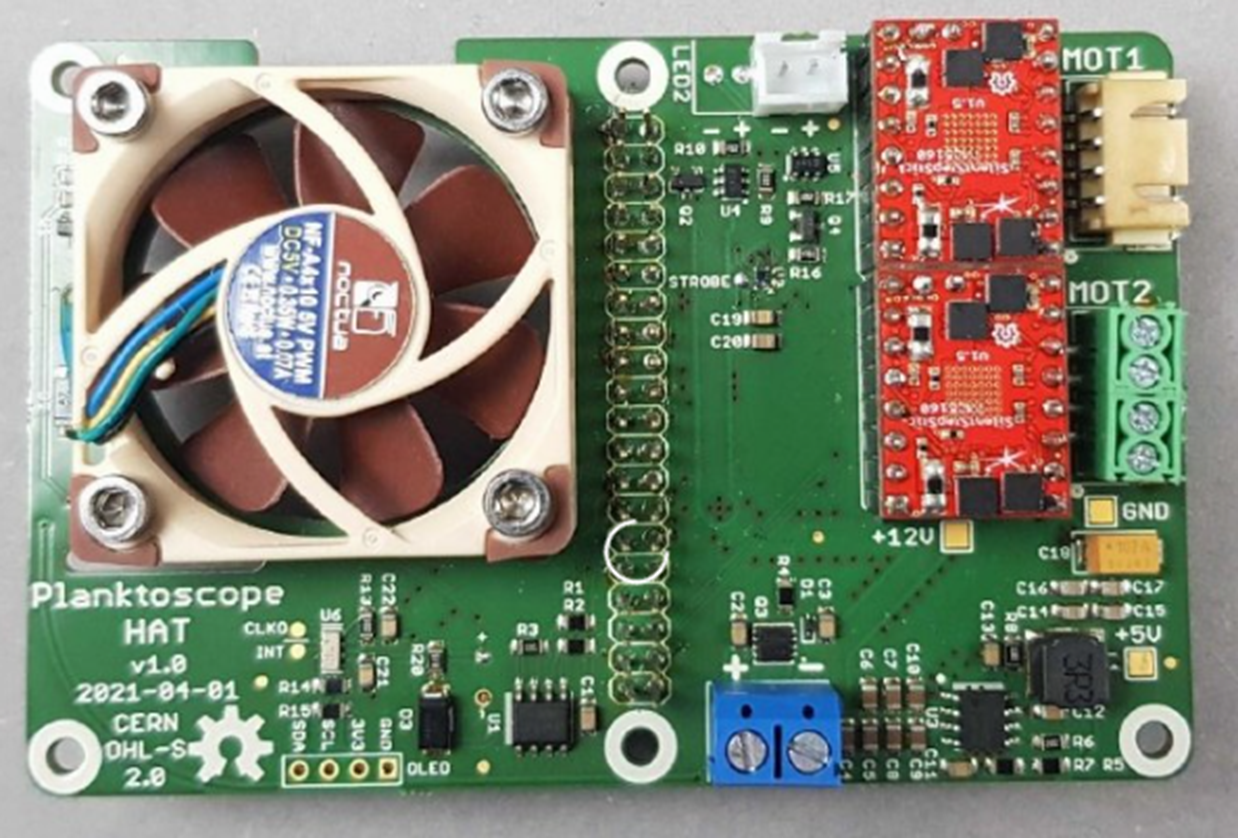

3.2 科学研究

多模态AI正在深刻改变科学研究的方式:

气候建模:结合多源观测数据(卫星、地面站、海洋浮标等)和气候模型,提高气候预测的准确性。

分子动力学:结合分子结构信息和实验数据,加速药物发现和材料设计。

材料设计:结合材料成分、结构、性能等多模态信息,设计新型功能材料。

自动化实验:AI可以生成假设,使用工具和应用来控制科学实验,并与人类和AI研究同事协作。

微软研究院预测,到2026年,AI不仅将总结论文、回答问题和撰写报告,还将积极参与物理、化学和生物学中的发现过程。这一转变正在创造一个世界,在这个世界中,每个研究科学家都可能拥有一个AI实验室助手。

3.3 工业应用

多模态AI在工业领域有广泛的应用:

质量检测:结合视觉检测和文本规范,实现产品质量的自动检测和分级。

设备监控:结合传感器数据、图像监控和设备日志,实现设备的预测性维护。

安全监控:结合视频监控和环境传感器,实现工厂安全监控和预警。

工业设计:结合设计参数、材料信息和性能要求,辅助工业产品设计。

3.4 娱乐与媒体

多模态AI在娱乐和媒体领域展现了巨大的潜力:

内容创作:结合文本、图像、音频等多模态信息,创作多媒体内容。

游戏AI:结合游戏状态、玩家行为、视觉信息等多模态数据,创建更智能的游戏NPC。

虚拟主播:结合语音合成、面部动画、肢体动作等多模态技术,创建逼真的虚拟主播。

AR/VR体验:结合视觉、听觉、触觉等多模态信息,创造沉浸式的AR/VR体验。

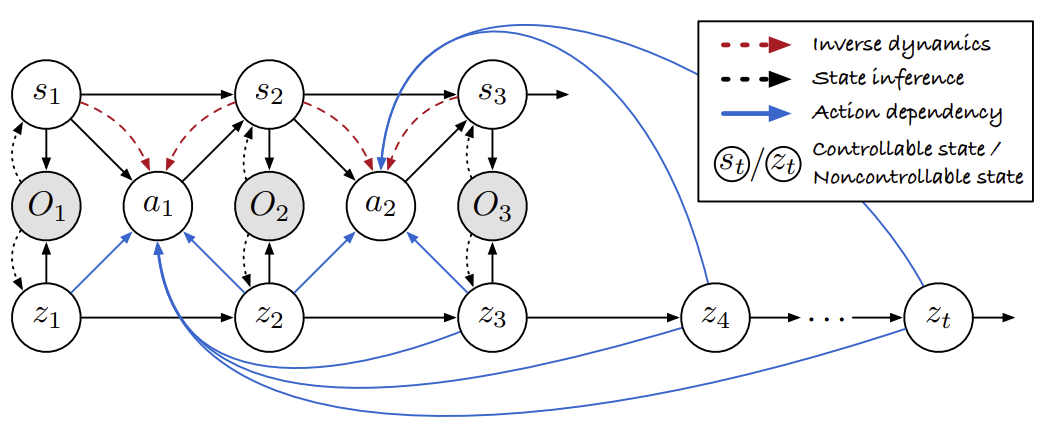

四、AI代理与多代理系统

4.1 从单一代理到超级代理

2026年,AI代理的发展呈现出从单一用途代理向”超级代理”演进的趋势:

单一用途代理阶段:2024年的代理大多是小型和专用的,如邮件撰写器、研究助手等。

推理能力提升阶段:随着推理能力的提升,代理开始能够规划、调用工具并完成复杂任务。

超级代理阶段:2026年将看到所谓的”超级代理”的兴起。超级代理能够跨越多个环境(浏览器、编辑器、收件箱)操作,而无需管理十几个单独的工具。

控制平面阶段:代理控制平面和多代理仪表板将成为现实。开发者可以从一个地方启动任务,代理将跨环境运行。

4.2 代理间通信协议

代理间通信(Agent-to-Agent Communication,A2A)是AI代理系统的重要基础设施。2026年,A2A的发展取得了重要进展:

协议成熟与融合:Anthropic推出的MCP、IBM的ACP和Google的A2A等协议正在走向成熟和融合。

开源治理:MCP已纳入开源治理,开放治理的社区标准将释放更多创造力、创新和解决方案。

标准化推进:A2A项目即将首次重大发布,A2A和MCP之间正在进行合作,标准化用于描述实体(无论是MCP中的工具或资源,还是A2A中的代理)的单一卡片。

互操作性:统一卡片将成为互操作性的催化剂,使代理和代理系统能够共享注册表、发现和利用。

4.3 多代理系统的生产化

IBM的研究人员指出,2026年是所有多代理系统从实验室走向生产的一年。这一转变取决于协议的成熟度和融合度:

Linux Foundation的贡献:IBM的BeeAI和Agent Stack项目已贡献给Linux Foundation,体现了开源社区在推动多代理系统发展中的重要作用。

Agentic AI Foundation:Linux Foundation宣布成立Agentic AI Foundation,Anthropic贡献了MCP协议。

生产用例:多代理系统将开始出现广泛的生产用例,代理与代理之间的通信将成为现实。

五、人机协同的新范式

5.1 AI作为数字同事

微软首席产品官Aparna Chennapragada认为,2026年将是一个人类与技术之间新联盟的时代。过去几年是关于AI回答问题和推理问题,下一波将是关于真正的协作。

AI代理将成为数字同事,帮助个人和小团队发挥更大的潜力。Chennapragada设想了一个工作场所,一个三人团队可以在几天内启动一场全球活动,AI负责数据处理、内容生成和个性化,而人类负责战略和创意。

这一发展对专业人员的建议是:不要与AI竞争,而应专注于学习如何与AI共事。未来属于那些提升人类角色而非消除人类角色的人。

5.2 目标-验证协议(Objective-Validation Protocol)

IBM量子与AI副总裁Ismael Faro指出,软件实践将从vibe coding演进到目标-验证协议。在这种新范式下:

用户定义目标:用户定义目标并进行验证 代理自主执行:代理集合自主执行,扩展人在环的概念 人类关键节点批准:在关键检查点请求人类批准

这一转变将推动代理运行时的出现,以使用控制机制运行复杂工作流,并将代理行为从静态的、代码绑定的输出转变为动态的自适应。

5.3 人机在环的重要性

IBM研究员Aaron Baughman强调,实现完全自主并不是移除人类监督。相反,在未来拥有人在环的AI至关重要,这样人类可以微调和改变技能。

人机在环的优势包括:

- 确保AI系统的安全性和可靠性

- 提供最终的决策和验证

- 处理AI无法应对的复杂情况

- 保持人类的创造力和创新性

六、挑战与展望

6.1 技术挑战

多模态AI和AI代理系统面临以下技术挑战:

模态融合:如何有效融合不同模态的信息,捕捉模态间的关联性和互补性。

数据质量:高质量的跨模态数据稀缺,需要开发有效的数据收集、标注和增强方法。

评估标准:多模态AI和代理系统的评估标准尚不完善,需要建立统一的评估框架。

可解释性:多模态模型和代理系统的决策过程复杂,可解释性要求高。

安全性:多模态AI和代理系统可能面临新的安全威胁,需要建立完善的安全防护体系。

6.2 伦理和社会挑战

多模态AI和代理系统也面临伦理和社会挑战:

隐私保护:多模态AI涉及大量个人数据,如何保护隐私是一个重要问题。

公平性:需要确保多模态AI和代理系统的公平性,避免歧视和偏见。

责任归属:代理系统的自主决策引发责任归属问题,需要明确法律和伦理框架。

就业影响:AI代理可能影响某些就业岗位,需要考虑其社会影响。

监管政策:需要制定适当的监管政策,平衡创新和风险。

6.3 未来展望

展望未来,多模态AI和代理系统的发展将呈现以下趋势:

更深入的多模态融合:模型将能够更深入地理解和融合多种模态的信息。

更强大的推理能力:模型的推理能力将持续提升,能够解决更复杂的问题。

更完善的代理生态系统:代理系统的标准和协议将更加完善,形成繁荣的代理生态系统。

更自然的人机交互:人机交互将更加自然和流畅,代理将成为真正的数字同事。

更广泛的应用场景:多模态AI和代理系统的应用场景将不断拓展,深入到各行各业。

结论

2026年标志着多模态AI和AI代理系统从实验室走向实用化的关键节点。大语言模型的感知能力突破、多模态AI的深度融合、代理间通信协议的标准化,共同推动着AI从理解语言到感知世界的跨越式发展。

在医疗健康、科学研究、工业应用、娱乐媒体等领域,多模态AI正在展现出巨大的应用潜力。与此同时,人机协同的新范式正在形成,AI代理将成为真正的数字同事,与人类协同工作,创造更大的价值。

未来,随着技术的不断进步和应用的不断深入,多模态AI和代理系统将继续发展,为人类社会的进步做出更大的贡献。

参考文献

- IBM Think. The trends that will shape AI and tech in 2026. 2026年1月1日.

- Microsoft Source. What’s next in AI: 7 trends to watch in 2026. 2025年12月8日.

- MIT Technology Review. Generative coding: 10 Breakthrough Technologies 2026. 2026年1月12日.

- InfoWorld. 6 AI breakthroughs that will define 2026. 2026年.

- E4 Company. 2026, the year AI comes of age: a strategic outlook from E4. 2026年1月.

- IT Brief. Nine Predictions for AI in 2026, from the Father of AGI. 2026年1月.

- Microsoft Research. AI in Scientific Research: The Next Frontier. 2025年.

- IBM Research. BeeAI and Agent Stack Projects. 2025年.

- Linux Foundation. Agentic AI Foundation. 2025年.

- Anthropic. Model Context Protocol (MCP). 2025年.